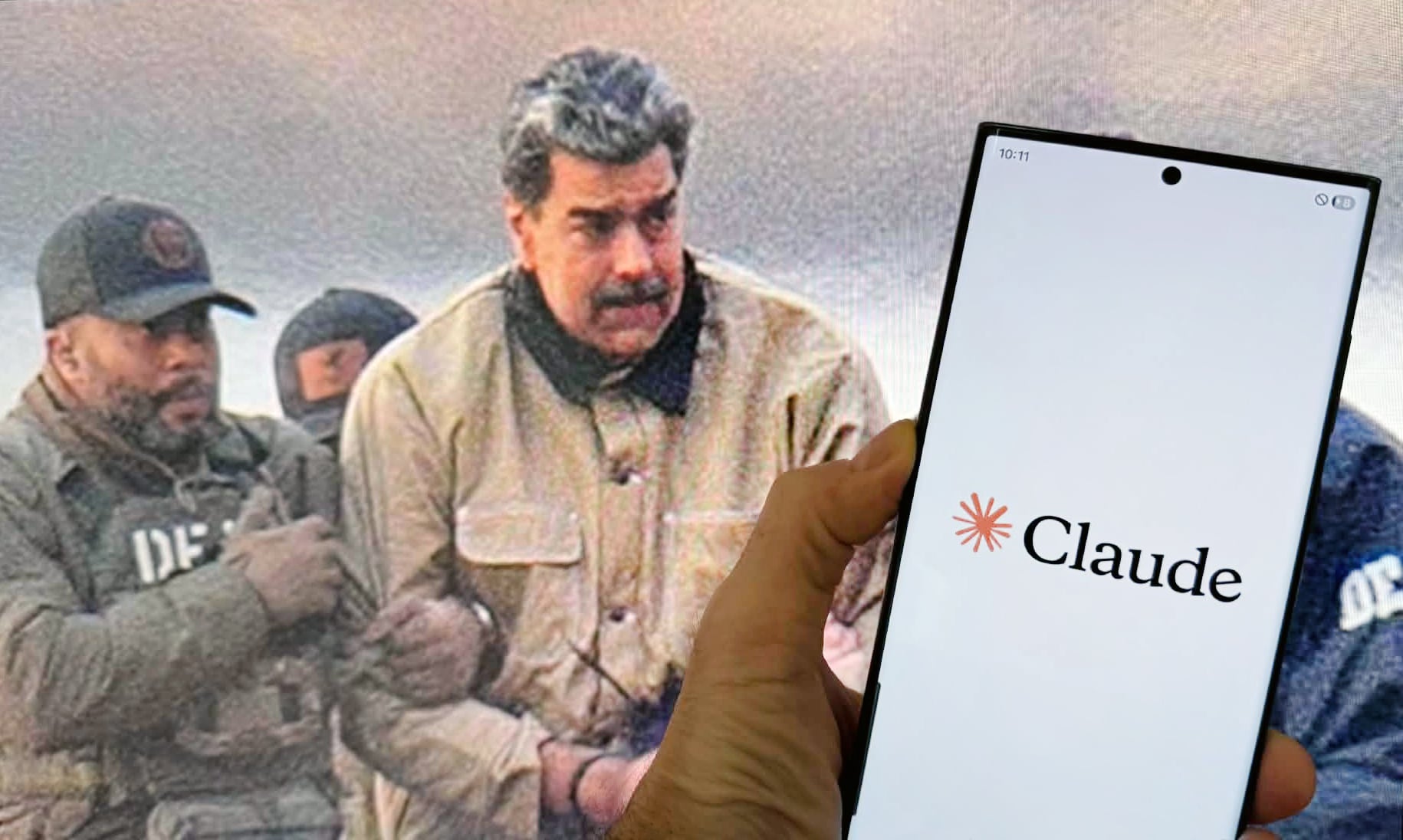

Armata Statelor Unite pare să fi făcut un pas surprinzător în utilizarea inteligenței artificiale pentru operațiuni de securitate, după apariția unor informații potrivit cărora modelul Claude, dezvoltat de compania americană Anthropic, a fost folosit în timpul operațiunii din Venezuela care a dus la capturarea lui Nicolás Maduro. Potrivit unui raport preluat de Reuters din The Wall Street Journal, această tehnologie avansată ar fi fost integrată pe platformele de analiză de date ale companiei Palantir, un jucător esențial în domeniul securității și intelligence-ului, colaborare susținută de Departamentul Apărării și alte agenții federale.

Utilizarea AI în operațiunea din Venezuela: o colaborație subtilă

Deși informațiile sunt încă neclare și neconfirmate independent, ele ridică întrebări fundamentale despre modul în care armata americană folosește inteligența artificială în misiuni cu implicații politice și de securitate la nivel global. Se pare că Claude a fost utilizat printr-o „ușă laterală”, adică o integrare a modelului pe infrastructură existentă de analiză a datelor, făcută de Palantir. Această metodă permite vehicularea AI-ului în contexte unde infrastructura de securitate națională și informațiile ultra-confidențiale trebuie să fie protejate, dar în același timp accesibile pentru luarea deciziilor rapide.

Pentru industria de profil, această conexiune devine un exemplu clar al modului în care modelele comerciale de AI, în mod tradițional rezervate pentru aplicații civile, pot fi adaptate și folosite în medii guvernamentale sensibile. Palantir, compania care a facilitat această integrare, are deja o prezență solidă în sectorul securității naționale, fiind contractată pentru gestionarea unor volume uriașe de date și analiza lor în timp real. În cazul de față, franciza AI – Claude – se pare că s-a alăturat arsenalului tehnologic utilizat pentru operațiuni de nivel înalt, ceea ce ridică semne de întrebare în privința controlului și reglementării acestor tehnologii.

Presiuni pe companiile de AI pentru acces mai rapid și mai liber

Între timp, sursele indică o mișcare din partea Pentagonului pentru a obține acces mai rapid la cele mai avansate modele de inteligență artificială. Se pare că oficialii americani sfătuiesc companiile precum OpenAI și Anthropic să permită o integrare mai liberală a acestor tehnologii în rețelele și mediile clasificate, cu mult mai puține restricții decât cele aplicate utilizatorilor civili. Această strategie vizează crearea unui ecosistem AI ce poate funcționa fără bariere, chiar și în cele mai sensibile zone, unde datele și misiunile pot fi extrem de delicate.

Această abordare a generat deja o dezbatere intensă în domeniul eticii și al securității, fiind interpretată ca un pas spre utilizarea AI în forma sa cea mai puternică, dar și mai riscantă. Odată cu accesul rapid la modele din ce în ce mai avansate, autoritățile americane vor să asigure că tehnologia poate fi folosită pentru prevenirea amenințărilor, dar în același timp există temeri serioase legate de potențialele abuzuri și de lipsa unui control adecvat.

Paradoxul moral și riscurile unei tehnologii din ce în ce mai autonome

Cel mai complicat aspect îl constituie însă faptul că politicile publice ale companiei Anthropic impun restricții clare față de utilizarea modelului Claude pentru activități ce implică violența, arme sau supraveghere. În teorie, Claude nu trebuie folosit pentru a sprijini acțiuni violente sau pentru a construi arme, iar aceste restricții sunt destul de stricte. Cu toate acestea, dacă apar informații confirmând că modelul a fost, de fapt, implicat într-o operațiune de forță—cum ar fi capturarea lui Maduro—urma să devină un subiect arzător în dezbaterea despre limitele și responsabilitatea utilizării AI în domenii sensibile.

Conform unor surse, Maduro a fost transportat la New York pentru a face față unor acuzații legate de trafic de droguri, ceea ce înseamnă că AI-ul a fost folosit nu doar pentru analize, ci chiar în sprijinul unei acțiuni de forță cu implicații politice majore. Acest precedent ridică semne de întrebare despre cât de mult pot și trebuie să fie controlate aceste tehnologii, având în vedere riscul de a depăși limitele etice și legale acceptabile.

Pe măsură ce aceste dezvăluiri ies la iveală, primele reacții oficiale sunt încă așteptate, iar comunitatea internațională urmărește cu atenție evoluția acestor situații. Într-o lume în care AI-ul devine din ce în ce mai accesibil și mai integrat în deciziile strategice ale statelor, emergența unor astfel de scenarii nu poate fi decât un semnal de alarmă asupra responsabilităților și controalelor necesare pentru tehnologii atât de puternice.

Sursa: Playtech.ro